卒業研究のご紹介

2022年版

情報系所属学生

構内自走警備ロボットのためのカメラ画像セグメンテーションによる周辺環境認識

橋本 幸樹神奈川県

情報学部情報工学科ICTスペシャリスト特別専攻

2022年3月卒業

2022年3月卒業

神奈川県立相模原中等教育学校出身

研究の目的

近年、日本では少子高齢化が深刻化してきており、労働力の確保がますます難しくなってきています。そこで、様々な業種においてその労働力をロボットで代替しようとしています。本学でも、「KAITモビリティリサーチキャンパス」と銘打った、ロボットを用いた業務効率化計画が進められています。

本研究で実現しようとしている自律走行ロボットにはWebカメラが搭載されています。このカメラを用いたロボット近距離の障害物等の検出方法を提案します。本研究の実現により、大学構内の清掃や警備は自動でロボットが担うことになるため、警備員等のコスト削減が期待できます。

本研究で実現しようとしている自律走行ロボットにはWebカメラが搭載されています。このカメラを用いたロボット近距離の障害物等の検出方法を提案します。本研究の実現により、大学構内の清掃や警備は自動でロボットが担うことになるため、警備員等のコスト削減が期待できます。

研究内容や成果等

■ セグメンテーションによる周辺環境認識

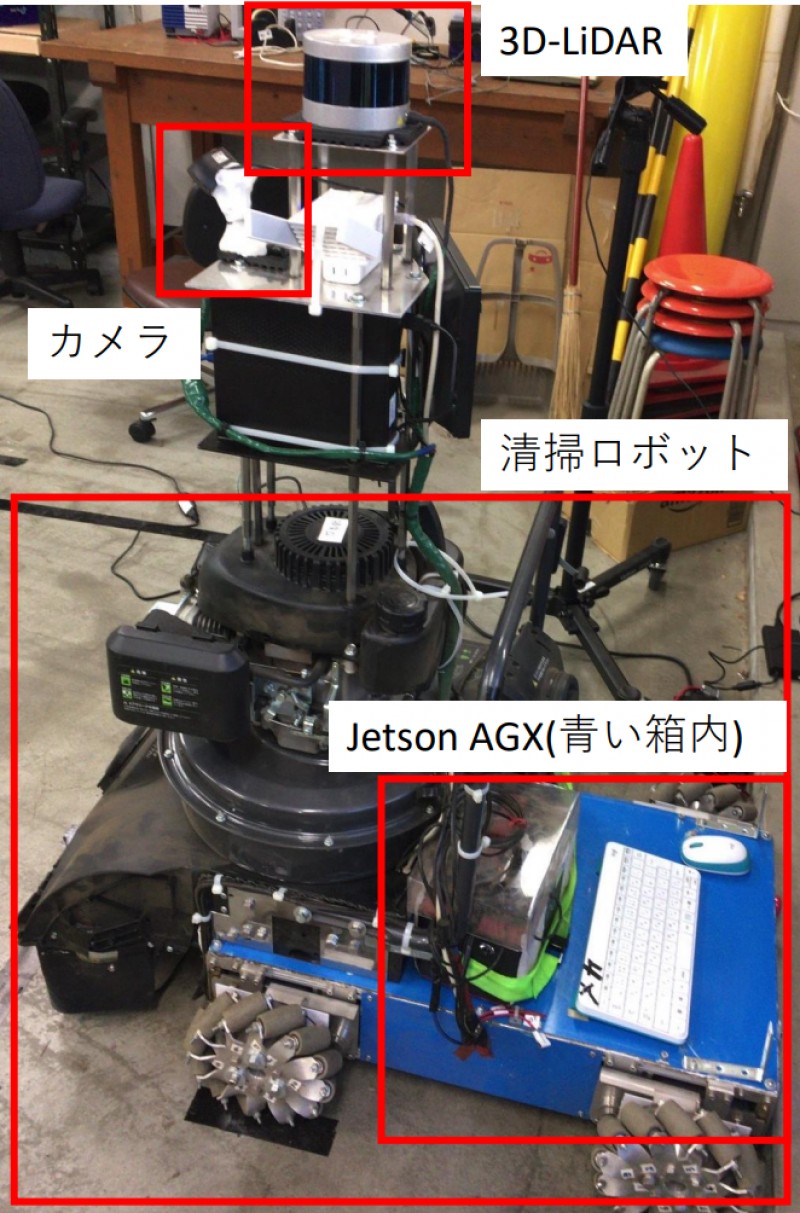

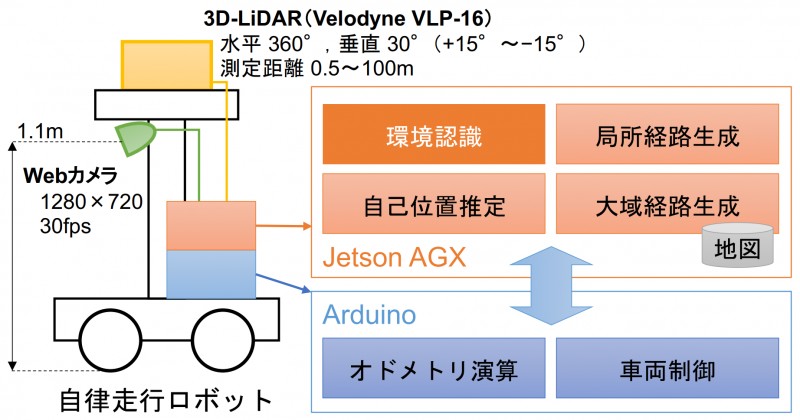

本研究で開発を進めている自律走行ロボットの外観を図1に、構成の概略を図2に示します。3D-LiDARとWebカメラはGPUを搭載した小型PC(Jetson AGX)に接続されており、Webカメラは地面から約1.1mの高さに取り付けられています。3D-LiDARの情報を元に人や障害物を回避する処理を行います。Webカメラ画像では、検出対象とする領域が不定形の場合もあるため、セマンティックセグメンテーションを用いて画素単位でクラス分割をします。画像のセグメンテーションには U-Netを用います。

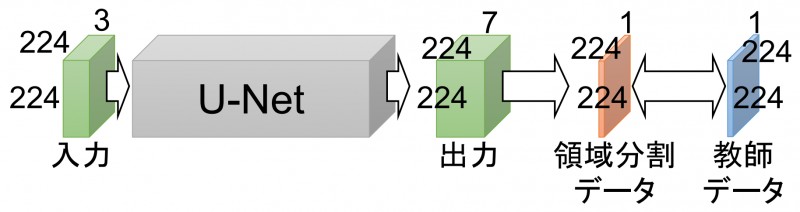

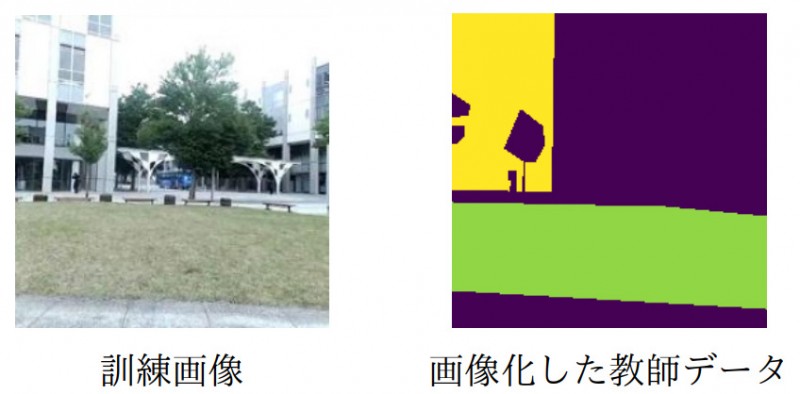

U-Netで学習するために、Web カメラで撮影した訓練画像に対してアノテーションを行い、教師データを作成します。ツール(VoTT)を使用して対象クラスの領域を多角形で囲み、多角形内の座標位置にクラスのラベルを付与します。図3にU-Netのデータ入出力と、出力結果から領域分割データを作成する流れを示します。出力データのサイズは224×224×7であり、チャンネルの7に各クラスの確率が格納されます。訓練画像と画像化したクラス(芝生、建物、背景)で色分けした教師データの例を図4に示します。

■ 実験・考察

本学構内で撮影した450枚の画像を使用して学習と評価を行いました。訓練用に画像 420枚、テスト用に30枚使用しました。U-NetのバックボーンにはResNet34を使用し、最適化手法にはAdamを、損失関数にはcategorical cross entropyを使用しました。Google Colaboratory上でバッチサイズ10、エポック数100で学習を行い、学習済みファイルをJetson AGXへ移して推論を行いました。

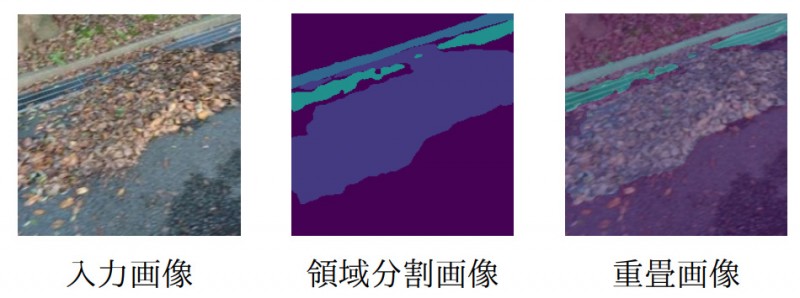

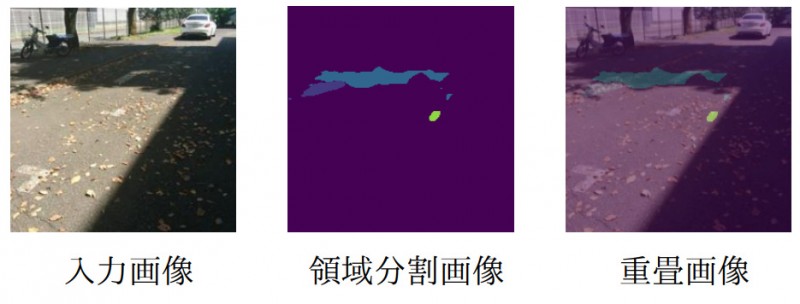

テスト画像の領域分割結果の例を図5、図6 に示します。なお、領域分割画像は領域分割データを画像化したものです。図5では、落ち葉、縁石、排水溝、背景の4クラスの領域が正しく分割できています。図6には落ち葉、縁石、車、背景の4クラスが含まれていますが、それぞれ検出した領域に誤りがありました。テストデータのうち、図6に示すような日向と日陰が含まれるパターンを除けば、高精度で領域分割できることが確認できました。日向と日陰が含まれる明暗差のあるパターンで領域分割精度が低下した要因は、学習時のデータ数が少なかったことやデータに偏りがあったことが考えられます。今後は、明暗差のある画像も増やして学習させていく必要があると考えます。また、今回の研究ではWebカメラ画像の領域分割手法の提案にとどまり、得られた結果をロボットの行動制御へつなげられていません。今後は、得られた情報をロボットが持っている地図情報へマッピングさせる方法を検討し、実際のロボットの行動制御に適用させていきたいと考えています。

■ まとめ

今回の研究では、3D-LiDARとWebカメラを搭載した自律走行ロボットの周辺環境認識手法を提案しました。Webカメラ画像に写る、形の定まらない物体に対してセマンティックセグメンテーションを利用し、領域分割を行いました。学習モデルにはU-Netを使用し、本学構内で撮影した画像を使って背景を含む7クラスを学習しました。テスト画像の領域分割では高い精度が得られましたが、日向と日陰で明暗差の大きい一部の画像において、精度が悪くなることを確認しました。今後は、対象クラスを増やすことや日陰や日向の場所による精度の低下を抑えることに加え、領域分割の結果をロボットの制御側へどのように渡すのかを考えていく必要があります。

研究活動を振り返り成長したこと

卒業研究全体を通し、失敗することの大切さを学びました。研究は初めから上手くいかないことがほとんどですが、何がダメでどう改善していけばよいのかを考えることで、結果がついてくるようになります。そうして失敗を乗り越え遠回りをしたものは、近道をしたものと比べ質が高いといえると思います。卒業研究では失敗を恐れず、たくさんチャレンジすることで、最終的には満足のいく結果になるはずです。このような貴重な経験ができ、非常に有意義でした。未来の卒研生(高校生)へのメッセージ

大学ではレポートや論文等、文章を書く機会が非常に多いです。そのため、早いうちから文章を書く練習をしておいた方が、大学は勿論社会人になってからも役に立つと思います。