卒業研究のご紹介

2019年版

機械・自動車・ロボット系所属学生

視線入力インタフェースに関する研究

小澤 拓也東京都

大学院ロボット・メカトロニクスシステム専攻 博士前期課程1年

(創造工学部ロボット・メカトロニクス学科2019年3月卒業)

(創造工学部ロボット・メカトロニクス学科2019年3月卒業)

東京都立若葉総合高等学校出身

研究の目的

本研究は、電動車いすを視線入力インタフェースで動かすシステムの開発を目的とします。車いすを用いる障害者の一部に、後ろを見るのが難しい人がいます。その不便をなくそうと思いこのシステムの開発に取り組みました。本システムでは、電動車いすを単に動かすのではなく、後退するときに視線を使い動かすことにしました。その理由は、後ろが見えず衝突することがあるからです。首を動かせる人は後ろを見ることができます。しかし、首を動かせない人は後ろを見られません。本システムは、首を動かせない人でも物に衝突せず、電動車いすを視線センサで動かすものです。

研究内容や成果等

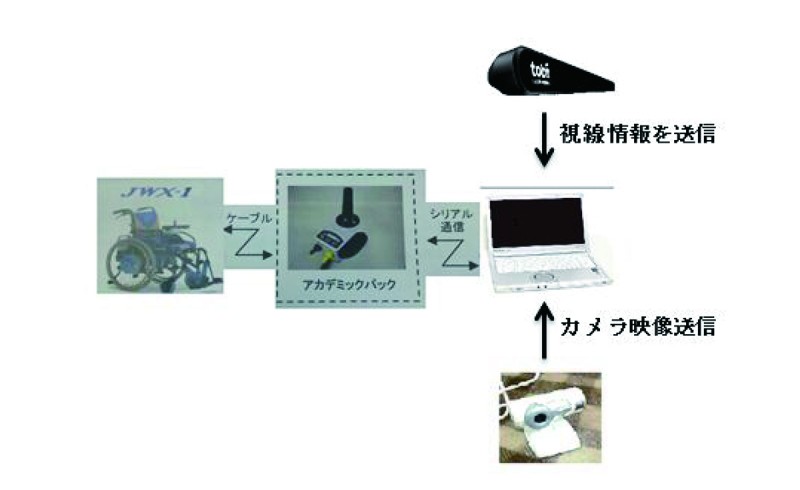

■ 本システムの構成を図 1 に示す。

■ 視線入力インタフェースの動作手順は以下の通り。

(1)USBカメラで電動車いすの後ろの映像をパソコンに送信し表示。(2)視線センサで使用者の視線の情報を取得しパソコンに送信。パソコンの出力結果の画面の視線の座標の位置に円の図形を表示。(3) USB カメラの映像の画面に表示したいくつかの四角形の中に視線の座標の位置がある時に、対応するシリアル通信のコマンドを送信し、電動車いすを動かす。

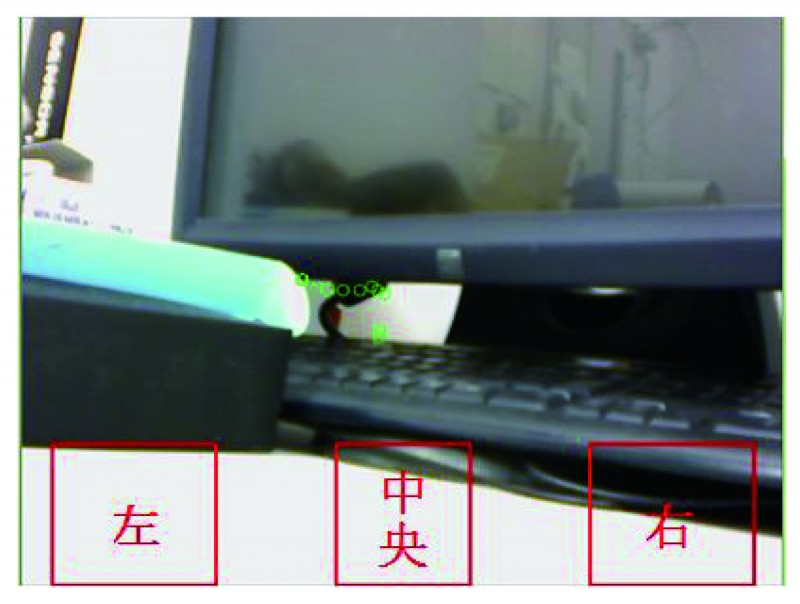

■ 実験

本実験では、首を動かせないもしくは動かしにくい肢体障害者が、パソコンの画面を見るだけで電動車いすを後退できるかどうかを検証した。被験者にパソコンから30cm程離れたところに座ってもらう。なお被験者は筆者1人、20代、男性、障害者とする。出力結果の画面の赤い長方形の中に視線の座標の位置がある時、電動車いすを左旋回、右旋回、後退するためにコマンドを送信。本実験は、図2のように出力結果の画面の左側、中央、右側の順に四角形の中をそれぞれ20回ずつ計60回一瞬だけ見て、正しく認識したかどうかを検証。但し、他の2か所を認識した場合は、正しく認識していないとする。シリアル通信するためのプログラムが正常に動かなかったため、シリアル通信の部分をなくし、文字を表示したら 認識したということにした。

本実験の認識率は81.7%。また、左側の認識率は75%。認識しなかったことが後半に多く見られた。これは、少し目に疲れが出ていたのではないかと考えられる。中央の認識率は70%。右側の認識率は100%で、認識率が高かったのは、被験者が右側を見やすかったということが考えられる。

■ おわりに

本研究では電動車いすを視線入力インタフェースで動かすシステムを開発した。本システムでは、電動車いすを前方に動かすのではなく、後退するときに視線を使い動かすことが特徴である。今後は、電動車いすとパソコンでシリアル通信して電動車いすを動かせるようにしたい。

-

指導教員からのコメント

教授 河原崎 徳之

指導教員からのコメント

教授 河原崎 徳之

- 小澤拓也君の卒業研究「視線入力インタフェースに関する研究」は、電動車いすを画面上の視線位置により動かそうというものです。丁度、車のバックモニターと同じように、電動車いすにカメラとモニタを取り付け、カメラで後方のようすを映し、その映像のモニタ画面を見ることで、自動的に電動車いすを動かします。例えば、電動車いすでエレベータに乗り込んだとき、モニタ画面を見つめることで、そのままバックでエレベータを出られます。視線入力は、体を動かすのが困難な障碍者には、有効な入力手段ですが、安全かつ確実に機器を動かさなければなりません。この点でまだまだ解決すべき問題は多いですが、小澤君は大学院に進学し、実用的な視線入力インタフェースを開発するよう研究を続けます。

-

修士研究学生からの一言

小澤 拓也

修士研究学生からの一言

小澤 拓也

- 4年間の授業は主にプログラミングで役に立ちました。プログラミングする授業をもう少し取っておけば良かったと思いました。研究では河原崎教授の助力のもと、システムの開発を行いました。結果としては、カメラの映像と視線の位置の座標を一致させることはできました。しかし、車いすを動かすためのシリアル通信ができず車いすを動かせませんでした。システムを作るのに時間がかかってしまい、実験に時間をかけられませんでした。この先は、大学院でより発展させた研究を行う予定です。

- 創造工学部ロボット・メカトロニクス学科(大学サイト )

- 教員紹介ページ(大学サイト )

- 研究室ナビ(大学サイト)